안녕하세요, MoonLight입니다.

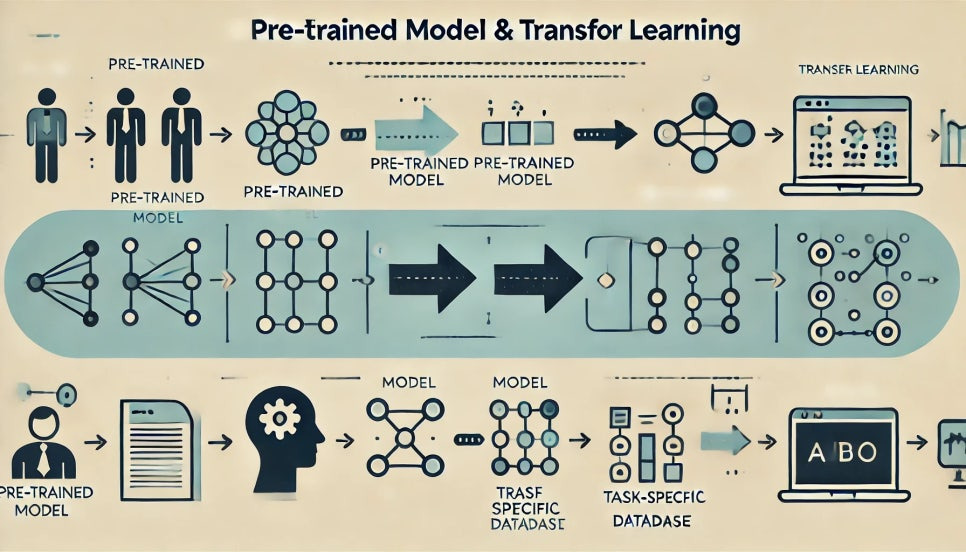

이번 Post에서는 Deep Learning 분야에서 많이 사용되는 Transfer Learning에 대해서 알아보도록 하겠습니다.

1. Transfer Learning 개요

1.1. Transfer Learning이란 ?

Deep Learning이 급속도로 발전하면서 Model의 성능이 비약적으로 향상되었지만, 여전히 Model을 처음부터 학습시키는 것은 매우 어려운 과제입니다.

우수한 성능을 갖춘 Deep Learning Model을 훈련하려면 대량의 데이터와 강력한 연산 자원이 필요하며, 적절한 학습이 이루어지기까지 오랜 시간이 소요됩니다.

또한, Model 학습이 한 번에 완벽하게 된다는 것은 현실에서는 있을 수 없는 일이며, 매우 많은 시행착오를 거치게 됩니다.

그러나 현실적으로 모든 문제에 대해 새롭게 Model을 훈련하는 것은 비효율적이며, 오히려 기존에 잘 학습된 Model을 적절히 활용하는 것이 더 효과적인 경우가 많습니다.

이러한 이유때문에 등장한 개념이 Transfer Learning(전이 학습)입니다.

Transfer Learning은 이미 학습된 Model의 지식을 새로운 문제에 적용하는 기법으로, 특히 데이터가 부족한 경우나 연산 자원이 제한적인 환경에서 강력한 성능을 발휘할 수 있습니다.

이 방식은 다양한 인공지능 응용 분야에서 널리 사용되며, 기존 Model을 활용하여 빠르고 효율적인 학습을 가능하게 합니다.

1.2. Transfer Learning의 기본 개념

Transfer Learning은 기존에 학습된 Model이 학습한 지식을 새로운 작업(task)에 적용하는 방법입니다.

여기서 "지식"이란 Model이 훈련 과정에서 학습한 특징(feature), 가중치(weight), 표현 방식(representation) 등을 의미합니다.

일반적인 Machine Learning과 Deep Learning에서는 Model이 처음부터 데이터셋을 이용해 학습해야 합니다.

하지만 Transfer Learning에서는 대규모 데이터셋을 기반으로 이미 학습된 Model을 가져와 새로운 문제에 맞게 일부 조정(fine-tuning)하거나, 특정 부분만 활용하여 원하는 작업을 수행할 수 있습니다.

'어떻게 이런 일이 가능하지?' 라고 생각하실 수 있으시겠지만, Deep Learning Model의 신경망의 구조를 알면 이것이 가능하다는 것을 알 수 있습니다.

일반적으로 신경망 구조에서 앞쪽(입력 부분)은 데이터의 기초적인 특징(선, 모서리, 텍스처 등)을 학습하고, 뒤쪽(출력 부분)으로 갈수록 점점 더 복합적이고 추상적인 특징(형태, 개체 등)을 학습하게 됩니다.

신경망 Model의 끝부분에서는 이러한 추상적 특징들을 활용하여 최종적인 분류 작업을 수행합니다.

Transfer Learning에서는 사전 학습된 Model이 학습한 특징 추출 기능(Feature Extraction)을 그대로 활용하고, 필요한 경우 출력 계층(Fully Connected Layer)을 새롭게 변경하거나 일부 계층을 Fine-Tuning하여 새로운 문제에 적용하는 방식으로 사용합니다.

이러한 접근 방식은 사람의 학습 과정에서도 유사한 측면을 확인할 수 있는데, 예를 들어, 이미 영어를 배운 사람이 프랑스어나 독일어를 배울 때 완전히 처음부터 배우는 것이 아니라, 영어와 유사한 문법적 구조나 단어를 활용하여 학습 속도를 높이는 것과 같은 원리입니다.

1.3. Deep Learning과 전이 학습(Transfer Learning)의 필요성

Transfer Learning이 필요한 대표적인 이유는 다음과 같은 것들이 있을 수 있습니다.

1) 데이터 부족 문제 해결

Deep Learning Model을 효과적으로 훈련하려면 대량의 라벨링된 데이터가 필요하지만, 대부분의 경우에는 이런 Train Data를 모으기가 쉽지 않습니다. 더욱이 특정 분야에서는 데이터 수집이 매우 어렵거나 비용이 많이 드는 경우도 많습니다.

이런 경우에 Transfer Learning을 활용하면, 대규모 공개 데이터셋에서 학습된 Model을 가져와 적은 데이터만으로도 높은 성능을 얻을 수 있는 Model을 학습하는 것이 가능합니다.

2) 학습 시간 단축

Deep Learning Model을 처음부터 학습시키는 것은 많은 시간과 연산 자원(GPU)이 필요한 과정입니다. 하지만, 이미 학습된 Model을 활용하면, 일부 계층만 재학습하거나 그대로 사용할 수 있어 학습 속도를 크게 단축할 수 있습니다.

3) 연산 자원 절약

대규모 신경망을 훈련하려면 GPU 등의 고성능 하드웨어가 필요하지만, Transfer Learning을 이용하면 상대적으로 적은 연산 자원으로도 높은 성능을 기대할 수 있습니다.

4) 성능 향상

데이터가 부족하거나 Model을 처음부터 학습시키기 어려운 환경에서는, 사전 학습된 Model을 활용하는 것이 더 나은 성능을 제공할 가능성이 높습니다.

왜냐하면, 이미 성능이 검증된 Model의 구조와 함께 학습된 Parameter까지 같이 사용하기 때문입니다.

2. Transfer Learning의 작동 방식

2.1. 기존 Model 학습과 전이 학습의 차이

기존 Model 학습(From Scratch Training)은 처음부터 모든 가중치를 랜덤하게 초기화하고 데이터를 이용해 하나씩 학습해 나가는 방법입니다.

다음으로 우리가 지금 알아보고 있는 전이 학습(Transfer Learning) 방식인데,이 방식은 이미 학습된 Model의 지식을 새로운 작업(Task)에 맞춰 재사용하는 방법입니다.

두 방식 모두 특정한 문제를 해결하기 위해 사용되지만, 적용 방식과 학습 과정, 그리고 필요로 하는 데이터와 연산 자원의 측면에서 큰 차이가 있습니다.

기존 Model 학습과 전이 학습의 비교

|

항목 기존

|

Model 학습 (From Scratch)

|

전이 학습 (Transfer Learning)

|

|

데이터 요구량

|

대규모 데이터셋 필요

|

적은 데이터로도 가능

|

|

학습 시간

|

매우 길다 (수십 시간 ~ 수주)

|

비교적 짧다 (수분 ~ 수시간)

|

|

연산 자원

|

고성능 GPU 필요

|

상대적으로 적은 자원 필요

|

|

Model 성능

|

데이터가 많을 경우 높은 성능 가능

|

적은 데이터에서도 높은 성능 가능

|

|

적용 용도

|

새로운 문제를 처음부터 해결할 때

|

기존 Model을 활용하여 유사한 문제를 해결할 때

|

기존 Model 학습과 전이 학습을 비교해 보면, 전이 학습은 데이터가 부족한 상황에서 빠르게 학습할 수 있으며, 연산 자원을 절약할 수 있다는 점에서 매우 유용한 방법임을 알 수 있습니다.

2.2. Feature Extraction과 Fine-Tuning 개념

Transfer Learning의 학습 과정은 Feature Extraction(특징 추출)과 Fine-Tuning(세부 조정)이라는 두 가지 주요 기법을 중심으로 이루어져 있습니다.

1) Feature Extraction (특징 추출)

· 사전 학습된 Model에서 학습된 특징을 그대로 사용하여 새로운 데이터에 적용하는 방식입니다.

· 기존 Model의 가중치를 그대로 유지한 채, 마지막 분류기(Classifier) 부분만 새로운 데이터에 맞게 학습하는 것을 말합니다.

· 예를 들어, ImageNet 데이터셋으로 학습된 ResNet, VGG 같은 Model의 초기 계층(layer)은 엣지(edge), 텍스처(texture),

기본적인 형태(shape)와 같은 일반적인 특징을 학습하고 난 후에,

· 이 정보는 다른 이미지 분류 문제에도 유용하므로, 초기 계층을 그대로 유지하고 최종 계층만 새로운 데이터셋에 맞게 변경하여 활용하는 방식입니다.

· Feature Extraction 방식은 데이터가 적을 때 효과적이며, 계산 비용이 낮아 학습 속도가 빠르다는 특징이 있습니다.

2) Fine-Tuning (세부 조정)

· Feature Extraction과 달리, 기존 Model의 일부 또는 전체 가중치를 새로운 데이터셋에 맞게 조정하는 방식입니다.

· 초기 계층은 일반적인 특징을 학습하지만, 후반부 계층은 특정 데이터셋에 특화된 특징을 학습하므로, 새로운 작업에 맞춰 후반부 계층의 가중치를 재학습하는 것이 일반적입니다.

· Fine-Tuning을 적용하면 더 높은 성능을 기대할 수 있지만, 적절한 하이퍼파라미터 조정과 과적합 방지 기법이 필요합니다.

즉, Fine-Tuning과 Feature Extraction 핵심 차이는 Feature Extraction은 기존 Model의 대부분의 파라미터를 그대로 유지하고, 최종 분류기(Fully Connected Layer)만 새롭게 학습하고, Fine-Tuning 기법은 기존 Model의 일부 계층(주로 후반부)의 가중치를 업데이트하여 새로운 데이터셋에 적응한다는 점입니다.

3. Transfer Learning Model 종류

3.1. Pre-Trained Model이란?

1. 사전 학습된 Model(Pre-Trained Model)이란?

성능 좋은 Deep Learning Model을 효과적으로 학습시키는 것은 쉬운 일이 아닙니다.

많은 양의 Train Data와 강력한 GPU로 오래 시간동안 Train을 하더라도 추가적인 최적화 과정이 필요하게 됩니다.

사전 학습된 Model(Pre-Trained Model)이란, 누군가 이미 대규모 데이터셋을 사용하여 미리 학습된 신경망 Model을 의미하며, 이를 기반으로 새로운 작업에 활용할 수 있도록 설계된 Model을 말합니다.

이렇게 좋은 Model을 공개해서 사용하게 해 주신 분들에게 감사한 마음을 가지며 사용해야 겠습니다.

2. Pre-Trained Model의 장점

사전 학습된 Model을 활용하면 다음과 같은 장점을 얻을 수 있다.

1) 데이터 요구량 감소

처음부터 학습하는 방식과 달리, 이미 학습된 가중치를 활용할 수 있으므로 적은 데이터로도 높은 성능을 낼 수 있습니다.

특히, 의료 영상 분석이나 위성 이미지 처리처럼 데이터가 제한적인 분야에서 매우 유용합니다.

2) 학습 시간 단축

Model을 처음부터 학습하려면 오랜 시간이 걸리지만, 사전 학습된 Model을 활용하면 일부 계층만 새롭게 학습하면 되므로 학습 시간을 크게 단축할 수 있습니다.

3) 일반화 성능 향상

대규모 데이터셋에서 학습된 Model은 다양한 특징을 이미 학습한 상태이므로, 새로운 데이터셋에서도 좋은 성능을 보일 가능성이 높습니다.

특히, Feature Extraction 방식을 사용할 경우, 기존 Model이 학습한 일반적인 특징을 그대로 활용할 수 있다.

3.2. Pre-Trained Model의 활용 분야

Pre-Trained Model은 거의 대부분의 Deep Learning Model 적용 분야에서 활용되고 있다고 보시면 되고, 대표적인 예시는 다음과 같다.

1) 이미지 처리 (Computer Vision)

대표적인 사전 학습된 Model : ResNet, VGG, EfficientNet, MobileNet, Inception 등

활용 사례 : 이미지 분류(Image Classification)

2) 자연어 처리 (Natural Language Processing, NLP)

대표적인 사전 학습된 Model : BERT, GPT, T5, XLNet, RoBERTa 등

활용 사례 : 감성 분석(Sentiment Analysis), 질의응답(Question Answering), 번역(Translation), 챗봇(Chatbot)

3) 음성 처리 (Speech Processing)

대표적인 사전 학습된 Model : DeepSpeech, Wav2Vec, Whisper 등

활용 사례 : 음성 인식(Speech Recognition), 음성 합성(Text-to-Speech), 감정 분석

4) 의료 영상 분석 (Medical Imaging)

X-ray, CT, MRI 분석에 사전 학습된 CNN Model을 적용하여 질병을 탐지하는 데 사용됨

3.3. Pre-Trained Model 선택 기준

앞에서 본 바와 같이 Pre-Trained Model은 매우 종류가 많습니다.

그렇다면, 어떻게 Pre-Trained Model을 선택하면 좋을 몇가지 기준을 알아보도록 하겠습니다.

1) 원본 데이터셋과의 유사성

Pre-Trained Model이 우리가 학습하려는 데이터셋과 유사할수록 높은 성능을 얻을 수 있을 것 입니다.

예 : ImageNet으로 학습된 CNN Model은 일반적인 사진 데이터에 적합하지만, 의료 영상에는 적절하지 않을 수 있습니다.

2) Model 크기와 연산 비용

대형 Model일수록 높은 성능을 낼 가능성이 크지만, 연산 자원이 많이 필요할 수 있습니다.

경량 Model(예: MobileNet, DistilBERT)은 연산 비용이 낮아 모바일 환경에서도 사용 가능하겠죠.

3) Fine-Tuning 가능 여부

특정 작업에 맞게 세부 조정이 가능한지 확인해야 합니다.

Pre-Trained Model들을 살펴보다 보면 Fine-Tuning이 안되는 Model들이 더러 있습니다.

그러니, 잘 살펴보고 선택하시는 것이 좋을 것 같습니다.

예를 들어, NLP에서 BERT Model을 사용할 경우, 특정 도메인(예: 의료, 법률)에 맞게 미세 조정(Fine-Tuning)이 가능해야 하겠죠.

4. Pre-Trained Model & Transfer Learning 관계

Transfer Learning의 핵심적인 개념은 사전 학습된 Model을 활용하는 것에서 출발합니다.

Transfer Learning은 바로 이 사전 학습된 Model을 기반으로 기존 지식을 재사용하고, 특정 작업(Task)에 맞게 일부 조정하여 학습하는 방법론입니다.

요약하면 Transfer Learning은 Pre-Trained Model을 활용하는 학습 기법이며, Pre-Trained Model은 Transfer Learning을 수행하기 위한 기반 Model이라고 할 수 있습니다.

예를 들면, 이미지 처리 분야에서는 ImageNet 데이터셋으로 학습된 ResNet, VGG, EfficientNet과 같은 CNN 기반 Model이 Pre-Trained Model이 있는데,

내가 가지고 있는 이미지들의 분류 작업에 사용하기 위해서 CNN 계층을 그대로 두고, 최종 Fully Connected Layer만 교체하여 내가 원하는 Model을 쉽게 만들 수 있습니다.

이미지 처리 분야 뿐만 아니라, 자연어 처리(NLP) 분야에서도 사용할 수 있습니다.

NLP 분야에는 BERT라는 Pre-Trained Model이 있습니다. BERT의 임베딩 계층을 그대로 사용하고, 분류기(FC Layer)만 교체하여 입력 문장의 감성 분석기로도 활용할 수 있습니다.

특히, NLP 분야에서는 사전 학습된 Transformer 기반 Model을 미세 조정(Fine-Tuning)하여 특정 도메인에 맞게 적용하는 것이 일반적임 추세입니다.

종합하면, Pre-Trained Model이 없다면 Transfer Learning은 불가능한 방법론입니다.

현대의 Deep Learning Model들은 거의 대부분이 처음부터 Model을 설계하는 일은 없으며, Pre-Trained Model을 적절하게 사용하여, 높은 성능의 Model을 빨리 만들어 냅니다.

도움이 되셨다면 좋겠네요.

다른 Post에서는 Transfer Learning을 이용해서 Image를 분류하는 실제 예제를 보여드릴 수 있도록 하겠습니다.

감사합니다.

'Deep_Learning' 카테고리의 다른 글

| DLSS (Deep Learning Super Sampling) (0) | 2025.03.22 |

|---|---|

| Pandas Dataframe에 apply()에서도 진척도 확인하기 (0) | 2025.03.03 |

| PyTorch에서 .to(device)를 사용하는 이유 (0) | 2025.02.20 |

| Anaconda PyTorch GPU 설치 (1) | 2024.09.21 |

| Learning to (Learn at Test Time): RNNs with Expressive Hidden States (0) | 2024.08.23 |